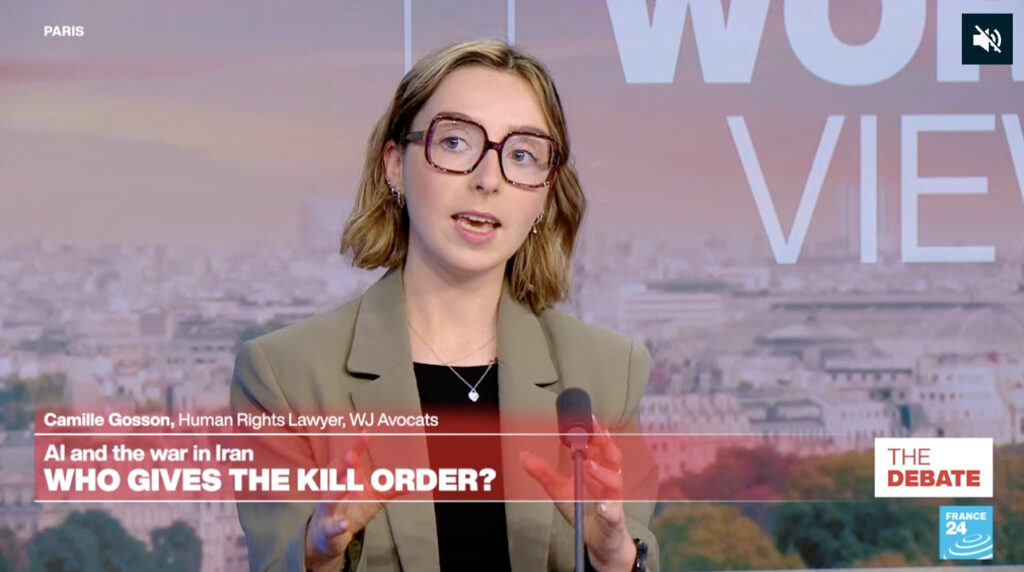

Maître Camille Gosson est intervenue dans l’émission Le Débat sur France 24 à la suite des conclusions préliminaires d’une enquête américaine suggérant que la frappe menée en février 2026 contre une école en Iran, qui a fait 175 morts, aurait été fondée sur des renseignements obsolètes produits par un système d’intelligence artificielle utilisé par l’armée américaine.

Elle a rappelé qu’au regard du Statut de Rome, la qualification de crime de guerre suppose l’existence d’un élément intentionnel. La négligence seule ne suffit en principe pas, sauf si une violation du droit international humanitaire peut être démontrée, notamment au regard du principe de précaution. Elle a mis en avant que la responsabilité ne se limite pas nécessairement aux seuls décideurs publics. Elle peut également concerner des acteurs privés, notamment les dirigeants d’entreprises impliquées dans le développement ou la fourniture de systèmes d’intelligence artificielle utilisés dans des opérations militaires.

Maître Camille Gosson a également souligné que, selon le consensus actuel en droit pénal international, le cadre juridique existant permet déjà de poursuivre les usages abusifs de l’intelligence artificielle, comme l’a récemment rappelé le Bureau du Procureur de la CPI dans une déclaration publiée en décembre 2025. Elle a toutefois relevé que l’émergence de systèmes véritablement autonomes — c’est-à-dire capables de décider d’une frappe sans intervention humaine finale — pourrait à terme soulever la question de l’adaptation du cadre juridique existant.